Witam Państwa na pierwszym wykładzie!

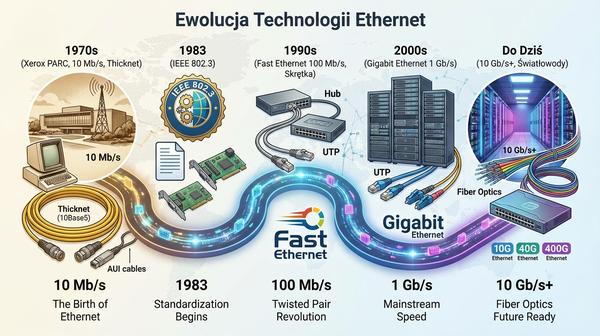

- Zaczniemy od samych podstaw, cofając się do lat 70., aby zrozumieć, jak narodziła się technologia, która dziś stanowi kręgosłup globalnej komunikacji – sieć Ethernet.

- Celem tego kursu jest zbudowanie solidnego fundamentu, od historycznych korzeni po praktyczną konfigurację współczesnych urządzeń.

- Proszę nie obawiać się zadawania pytań – jesteśmy tu, aby się uczyć.

- Nasza podróż rozpoczyna się w legendarnym ośrodku badawczym Xerox PARC (Palo Alto Research Center) na początku lat 70. XX wieku.

- To tam młody inżynier, Robert Metcalfe, wraz ze swoim zespołem, stanął przed wyzwaniem połączenia pierwszych na świecie komputerów osobistych, Xerox Alto, z drukarkami laserowymi.

- Istniejące technologie sieciowe były zbyt drogie i skomplikowane.

- Potrzebowano czegoś prostego, taniego i wydajnego, co umożliwiłoby lokalną wymianę danych.

- Tak powstała koncepcja sieci, którą Metcalfe nazwał "Ethernet", inspirując się XIX-wieczną teorią eteru, hipotetycznego ośrodka wypełniającego wszechświat.

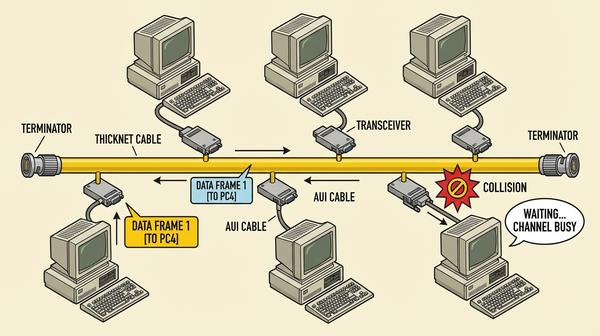

- Kluczową ideą wczesnego Ethernetu było wykorzystanie jednego, wspólnego medium transmisyjnego dla wszystkich podłączonych urządzeń – grubego kabla koncentrycznego.

- Proszę sobie wyobrazić, że wszystkie komputery w jednym pokoju są podłączone do tej samej, jednej "rury", przez którą przesyłane są dane.

- To genialne w swojej prostocie rozwiązanie miało jednak fundamentalną konsekwencję: w danym momencie tylko jedno urządzenie mogło nadawać.

- Gdyby dwa urządzenia zaczęły mówić jednocześnie, ich sygnały nałożyłyby się na siebie, tworząc niezrozumiały szum.

- Ten problem nazywamy kolizją.

- Aby zarządzać dostępem do wspólnego medium i unikać chaosu, twórcy Ethernetu opracowali genialny protokół o nazwie CSMA/CD (Carrier Sense Multiple Access with Collision Detection).

- Można go przyrównać do zasad kulturalnej rozmowy w grupie.

- Carrier Sense (CS): Nasłuchuj, czy ktoś inny nie mówi. Zanim zaczniesz nadawać, sprawdź, czy medium jest wolne.

- Multiple Access (MA): Każdy ma prawo do głosu. Wszystkie urządzenia mają równy dostęp do medium.

- Collision Detection (CD): Wykryj, jeśli ktoś zaczął mówić w tym samym czasie co Ty. Jeśli dojdzie do kolizji, przestań mówić.

- Dzięki tym prostym regułom, sieć mogła samodzielnie organizować ruch bez potrzeby centralnego zarządcy.

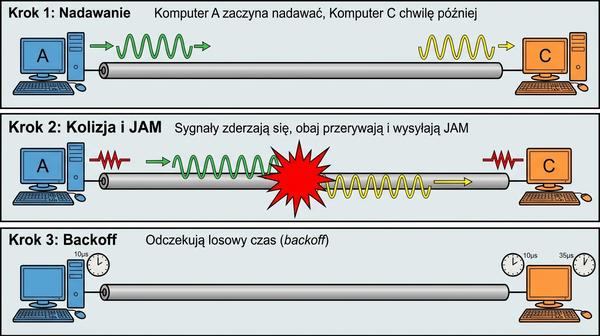

- Przeanalizujmy proces wysyłania danych w sieci z CSMA/CD.

- Komputer A chce wysłać dane do komputera B. Sprawdza, czy kabel (medium) jest wolny.

- Jeśli medium jest wolne, komputer A zaczyna nadawać ramkę danych, jednocześnie monitorując sygnał na kablu.

- W tym samym czasie komputer C również decyduje się na nadawanie, bo przed chwilą medium było wolne.

- Sygnały z A i C spotykają się na kablu, tworząc kolizję - skok napięcia, który jest nietypowy dla normalnej transmisji.

- Oba komputery (A i C) wykrywają kolizję (Collision Detection). Natychmiast przerywają nadawanie i wysyłają krótki sygnał zagłuszający (JAM), aby poinformować wszystkie inne urządzenia o zderzeniu.

- Po wysłaniu sygnału JAM, każdy z komputerów (A i C) uruchamia algorytm "binary exponential backoff" (binarnego wykładniczego odroczenia) - losuje czas, który musi odczekać przed ponowną próbą nadawania. Dzięki losowości jest mało prawdopodobne, że znów zaczną nadawać w tym samym momencie.

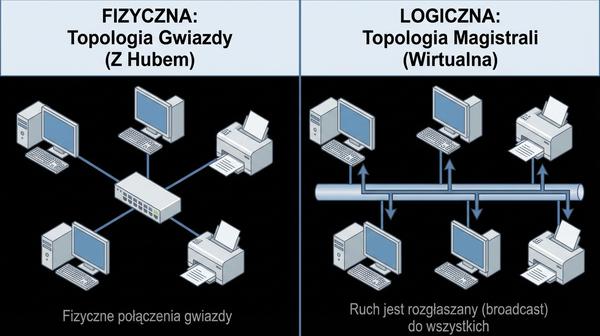

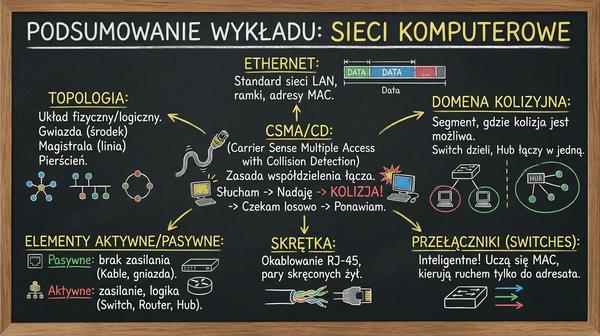

- W sieciach komputerowych musimy rozróżnić dwa fundamentalne pojęcia: topologię fizyczną i logiczną.

- Topologia fizyczna opisuje, w jaki sposób urządzenia są fizycznie połączone kablami. Odpowiada na pytanie: "Jak wygląda mapa kabli?". Przykłady to topologia magistrali, gwiazdy, pierścienia czy siatki.

- Topologia logiczna opisuje, w jaki sposób dane przepływają między urządzeniami, niezależnie od fizycznego ułożenia kabli. Odpowiada na pytanie: "Jak urządzenia ze sobą 'rozmawiają'?". Przykładem jest logiczna magistrala lub logiczny pierścień.

- Co ciekawe, topologia fizyczna i logiczna nie muszą być takie same. We wczesnym Ethernecie obie były topologią magistrali. Dziś najczęściej używamy fizycznej gwiazdy, która logicznie (przy użyciu koncentratora) nadal działa jak magistrala.

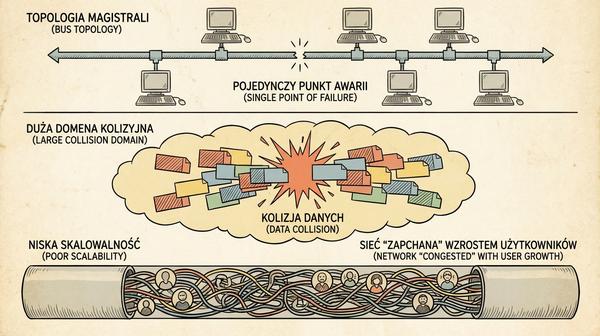

- Pierwsze sieci Ethernet były budowane w oparciu o fizyczną topologię magistrali.

- Wszystkie komputery i urządzenia sieciowe były podłączane do jednego, długiego segmentu kabla koncentrycznego.

- Do podłączenia stacji roboczych używano specjalnych złączy w kształcie litery T (trójników), które "wgryzały" się w główny kabel.

- Na obu końcach magistrali musiały znajdować się specjalne oporniki, zwane terminatorami, o impedancji 50 omów.

- Ich zadaniem było pochłanianie sygnału, aby nie odbijał się on od końca kabla i nie wracał, zakłócając transmisję.

- Brak lub uszkodzenie terminatora powodowało awarię całej sieci.

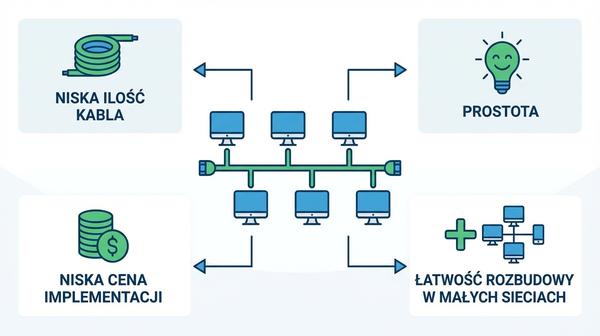

- Mimo swoich wad, topologia magistrali zdominowała wczesne sieci lokalne z kilku powodów.

- Przede wszystkim, była to technologia stosunkowo tania w implementacji.

- Wymagała znacznie mniejszej ilości kabla niż, na przykład, topologia gwiazdy, ponieważ nie trzeba było prowadzić osobnego przewodu od każdego komputera do centralnego punktu.

- Instalacja była prosta i nie wymagała skomplikowanych, aktywnych urządzeń pośredniczących, takich jak przełączniki.

- W małych sieciach, z kilkoma lub kilkunastoma komputerami, sprawdzała się całkiem dobrze i była łatwa do rozbudowy - wystarczyło "wpiąć" kolejny trójnik i podłączyć nowy komputer.

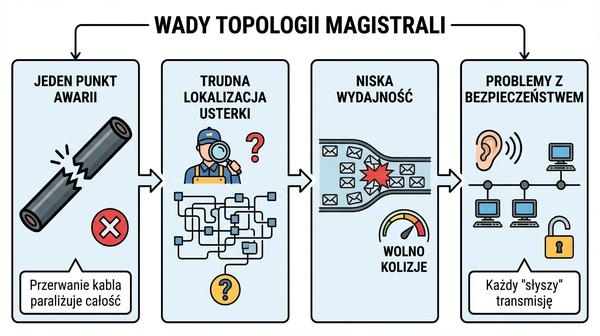

- Niestety, wady topologii magistrali szybko dały o sobie znać wraz ze wzrostem popularności sieci.

- Największym problemem była niska odporność na awarie.

- Przerwanie kabla w dowolnym miejscu powodowało awarię całego segmentu sieci, ponieważ sygnał nie mógł dotrzeć do terminatora i zaczynał się odbijać.

- Lokalizacja takiej usterki była niezwykle trudna i czasochłonna.

- Co więcej, wydajność sieci drastycznie spadała wraz z dodawaniem kolejnych użytkowników, ponieważ rosła liczba kolizji.

- Każde urządzenie musiało "walczyć" o dostęp do medium.

- Bezpieczeństwo również było problemem - każdy komputer w segmencie "słyszał" transmisję wszystkich innych.

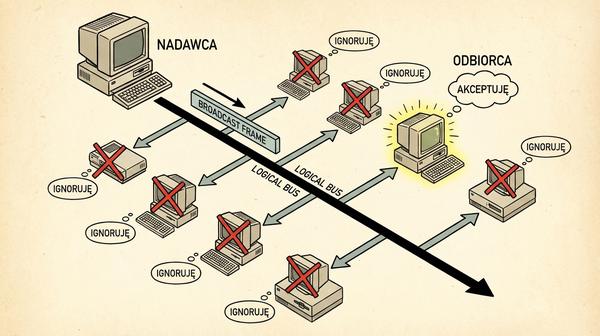

- Fundamentalną cechą logicznej magistrali jest komunikacja oparta na rozgłoszeniu (broadcast).

- Oznacza to, że gdy jedno urządzenie nadaje ramkę danych, jest ona odbierana przez wszystkie inne urządzenia podłączone do tego samego segmentu sieci.

- To trochę tak, jakby ktoś krzyczał informację w pokoju pełnym ludzi - wszyscy go słyszą.

- Każde urządzenie, które odbierze ramkę, analizuje jej nagłówek, aby sprawdzić adres docelowy (adres MAC).

- Jeśli adres docelowy w ramce zgadza się z adresem własnym urządzenia, ramka jest akceptowana i przetwarzana.

- W przeciwnym wypadku jest po prostu ignorowana.

- Ta zasada "jeden nadaje - reszta słucha" jest kluczowa dla zrozumienia działania wczesnego Ethernetu.

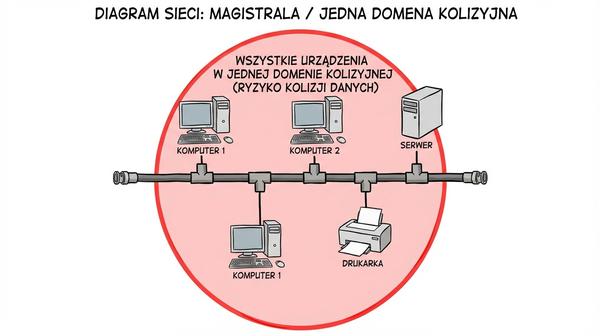

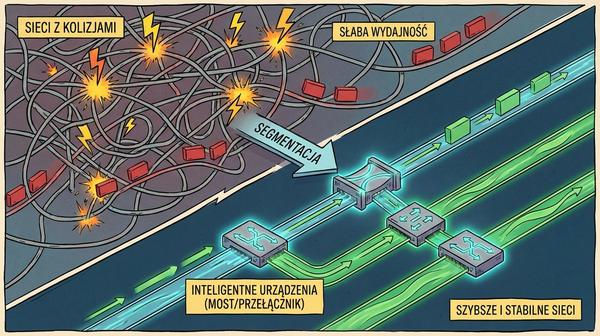

- Wprowadzamy teraz bardzo ważne pojęcie: domena kolizyjna.

- Jest to obszar sieci, w którym ramki danych wysyłane przez dwa różne urządzenia mogą się ze sobą zderzyć (doznać kolizji).

- W klasycznym Ethernecie opartym na topologii magistrali i kablu koncentrycznym, cały segment sieci stanowił jedną, dużą domenę kolizyjną.

- Oznaczało to, że im więcej komputerów dodawaliśmy do sieci, tym większe było prawdopodobieństwo wystąpienia kolizji i tym niższa stawała się efektywna przepustowość.

- Każdy musiał czekać na swoją kolej, a "wypadki" (kolizje) zdarzały się coraz częściej, spowalniając wszystkich.

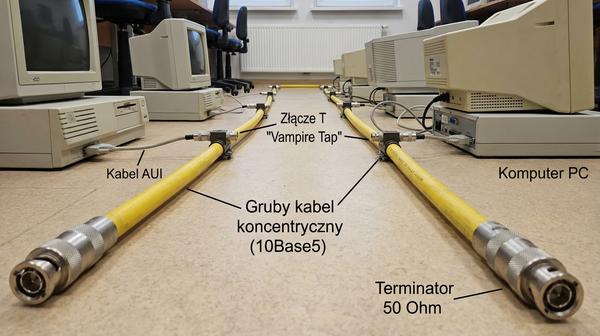

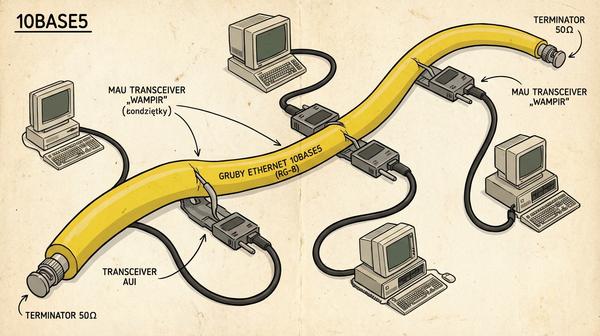

- Pierwszym standardem okablowania dla Ethernetu był 10BASE5, potocznie nazywany "Grubym Ethernetem" (Thick Ethernet).

- Nazwa pochodzi od grubego (ok. 1 cm średnicy), żółtego kabla koncentrycznego, który był sztywny i trudny w instalacji.

- Prędkość transmisji wynosiła 10 Mb/s, a maksymalna długość jednego segmentu to 500 metrów (stąd "5" w nazwie).

- Do podłączania urządzeń używano specjalnych urządzeń zwanych "transceiverami" lub "wampirami" (vampire taps), które dosłownie przebijały izolację kabla, aby uzyskać dostęp do miedzianego rdzenia.

- Była to technologia droga, nieelastyczna i skomplikowana w montażu.

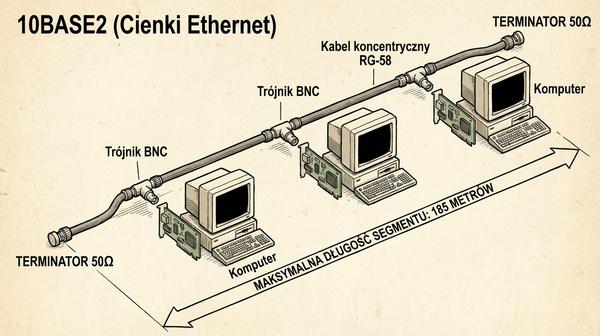

- Następcą 10BASE5 był standard 10BASE2, znany jako "Cienki Ethernet" (Thin Ethernet) lub "Cheapernet".

- Wykorzystywał on znacznie cieńszy, bardziej elastyczny i tańszy kabel koncentryczny (podobny do antenowego), co znacznie ułatwiało instalację.

- Zamiast "wampirek", stosowano wspomniane wcześniej złącza BNC i trójniki, które łączyły poszczególne odcinki kabla "od komputera do komputera".

- Maksymalna długość segmentu została skrócona do około 185 metrów (stąd "2" w nazwie, co jest zaokrągleniem).

- Mimo że był to krok naprzód pod względem kosztów i wygody, 10BASE2 wciąż cierpiał na wszystkie fundamentalne wady topologii magistrali, zwłaszcza na brak odporności na awarie.

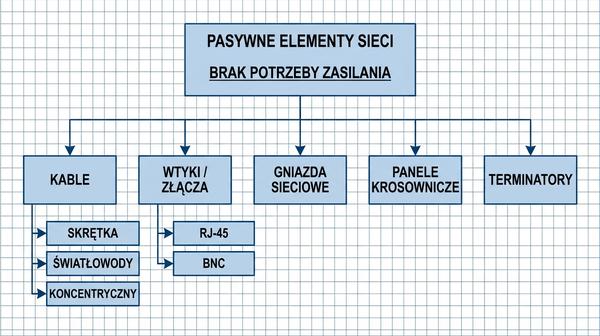

- Każda sieć komputerowa składa się z elementów pasywnych i aktywnych.

- Elementy pasywne to te składniki infrastruktury, które nie wymagają zasilania elektrycznego do swojego działania.

- Ich rolą jest wyłącznie tworzenie medium transmisyjnego – czyli drogi, którą mogą podróżować sygnały elektryczne lub świetlne.

- Są one fundamentem, na którym budujemy całą komunikację.

- Do podstawowych elementów pasywnych zaliczamy okablowanie (koncentryczne, skrętka, światłowody), wtyki i złącza (BNC, RJ-45), gniazda sieciowe, a także terminatory w starych sieciach magistralowych.

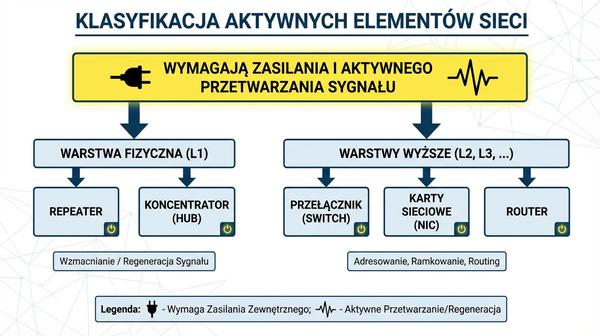

- W przeciwieństwie do elementów pasywnych, elementy aktywne to wszystkie urządzenia, które do swojego działania wymagają zasilania elektrycznego.

- Ich zadaniem jest nie tylko przesyłanie sygnału, ale również jego aktywne przetwarzanie – wzmacnianie, regenerowanie, a w przypadku bardziej zaawansowanych urządzeń, podejmowanie decyzji o jego dalszej drodze.

- We wczesnych sieciach Ethernet podstawowymi urządzeniami aktywnymi były repeatery (wzmacniaki) i koncentratory (huby), o których opowiemy więcej w kolejnych częściach.

- To właśnie one pozwoliły na rozbudowę sieci poza ograniczenia jednego segmentu kabla.

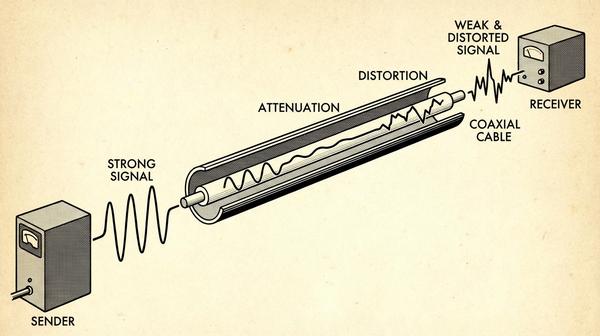

- Każdy sygnał elektryczny podróżujący przez kabel ulega zjawisku zwanemu tłumieniem (attenuation).

- Oznacza to, że z każdym metrem przebytej drogi sygnał słabnie, traci swoją moc i staje się coraz bardziej podatny na zakłócenia.

- To właśnie tłumienie jest głównym powodem, dla którego istnieją ograniczenia długości kabli w standardach sieciowych (np. 500m dla 10BASE5, 100m dla skrętki).

- Gdyby sygnał był zbyt słaby, urządzenie docelowe nie byłoby w stanie go poprawnie odczytać i zinterpretować.

- Aby temu zaradzić i budować większe sieci, wymyślono urządzenia aktywne, które potrafią "odświeżyć" sygnał.

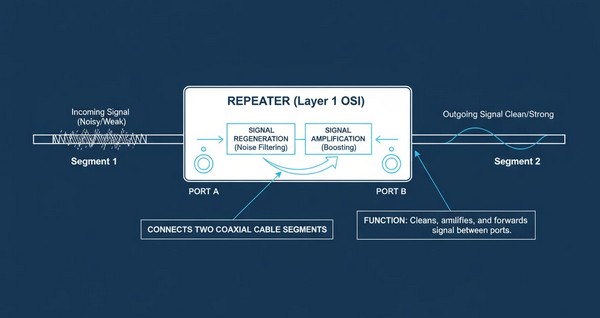

- Najprostszym urządzeniem aktywnym, służącym do walki z tłumieniem, jest repeater (wzmacniak).

- Jest to urządzenie działające w warstwie 1 (fizycznej) modelu OSI.

- Posiada dwa porty i jego zadanie jest niezwykle proste: wszystko, co odbierze na jednym porcie, regeneruje do pierwotnej postaci (usuwa szumy i przywraca kształt) i wysyła dalej drugim portem.

- Repeater nie analizuje żadnych adresów ani danych zawartych w ramce.

- Jest "elektrycznie przezroczysty" - po prostu kopiuje bity.

- Pozwalało to na łączenie dwóch segmentów kabla koncentrycznego i tworzenie dłuższych sieci, ale nie rozwiązywało problemu kolizji – wręcz przeciwnie, powiększało domenę kolizyjną.

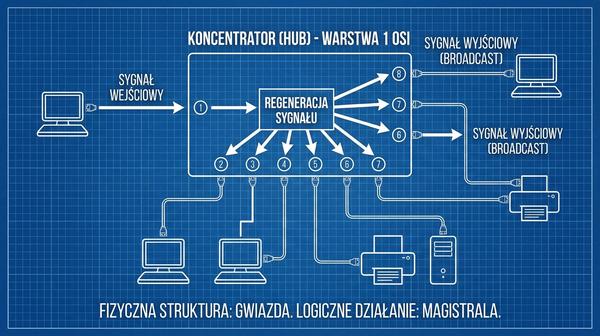

- Kolejnym krokiem ewolucji był koncentrator, czyli popularny hub.

- Można go sobie wyobrazić jako "wieloportowy repeater".

- To urządzenie również działa w warstwie 1 (fizycznej) i, podobnie jak repeater, nie analizuje żadnych adresów.

- Kiedy sygnał dociera na jeden z portów huba, jest on regenerowany, a następnie rozsyłany na wszystkie pozostałe porty.

- To właśnie hub umożliwił budowanie sieci w fizycznej topologii gwiazdy, gdzie każdy komputer miał swój własny kabel prowadzący do centralnego urządzenia.

- Mimo fizycznego wyglądu gwiazdy, sieć z hubem wciąż działała jak logiczna magistrala – wszystkie podłączone do niego urządzenia tworzyły jedną, wspólną domenę kolizyjną.

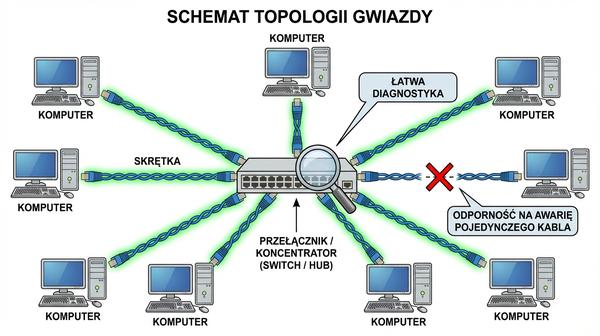

- Wprowadzenie koncentratorów i późniejszych przełączników zrewolucjonizowało budowę sieci lokalnych, popularyzując fizyczną topologię gwiazdy.

- W tym modelu każde urządzenie końcowe (komputer, drukarka) jest połączone osobnym kablem z centralnym punktem dystrybucyjnym – hubem lub switchem.

- Taka architektura jest znacznie bardziej odporna na awarie niż magistrala.

- Uszkodzenie jednego kabla powoduje odłączenie tylko jednego urządzenia, a reszta sieci działa bez zakłóceń.

- Diagnostyka problemów stała się o wiele prostsza – wystarczyło spojrzeć na diody na koncentratorze, aby zobaczyć, które połączenie nie działa.

- Równolegle z przejściem na topologię gwiazdy, nastąpiła rewolucja w okablowaniu.

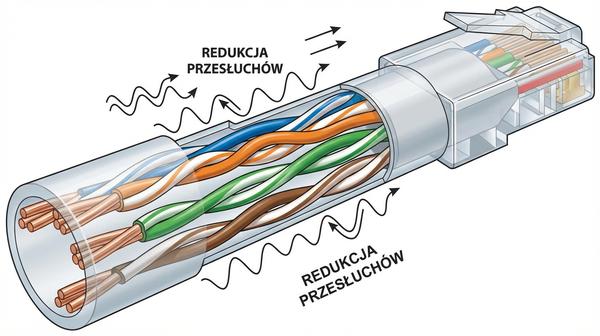

- Kable koncentryczne zostały wyparte przez znacznie tańszą, bardziej elastyczną i wydajniejszą skrętkę nieekranowaną (UTP - Unshielded Twisted Pair).

- Kabel ten składa się z czterech par skręconych ze sobą przewodów miedzianych.

- Skręcenie przewodów w parze nie jest przypadkowe – ma na celu redukcję zakłóceń elektromagnetycznych (tzw. przesłuchów).

- Skrętka, zakończona wtykiem RJ-45, stała się absolutnym standardem w budowie sieci LAN, umożliwiając osiąganie coraz wyższych prędkości – od 10 Mb/s, przez 100 Mb/s (Fast Ethernet), 1 Gb/s (Gigabit Ethernet) aż po 10 Gb/s i więcej.

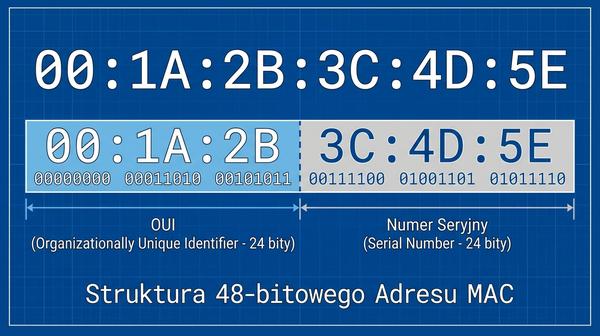

- Aby urządzenia w sieci Ethernet mogły się ze sobą komunikować, każde z nich musi posiadać unikalny identyfikator.

- Tym identyfikatorem jest adres MAC (Media Access Control).

- Jest to 48-bitowy (6-bajtowy) adres, "wypalany" na stałe w karcie sieciowej przez jej producenta.

- Adres MAC jest globalnie unikalny.

- Jego pierwsza połowa (24 bity) identyfikuje producenta sprzętu (jest to tzw. OUI - Organizationally Unique Identifier), a druga połowa (24 bity) to unikalny numer seryjny nadany przez tego producenta.

- Adres ten jest zapisywany w systemie szesnastkowym, np. `00:1A:2B:3C:4D:5E`.

- Dane w sieci Ethernet nie są przesyłane w sposób ciągły, lecz są dzielone na mniejsze porcje, opakowane w struktury zwane ramkami (frames).

- Ramkę można przyrównać do koperty z listem.

- Posiada ona nagłówek z adresem nadawcy i odbiorcy (adresy MAC), pole z właściwymi danymi (ładunek, np. fragment strony WWW) oraz "stopkę" zawierającą sumę kontrolną (FCS - Frame Check Sequence), która pozwala sprawdzić, czy dane nie zostały uszkodzone w transporcie.

- Dzięki podziałowi na ramki, sieć może efektywniej zarządzać ruchem i współdzielić medium.

- Każda ramka jest autonomiczną jednostką, która może być przesłana przez sieć.

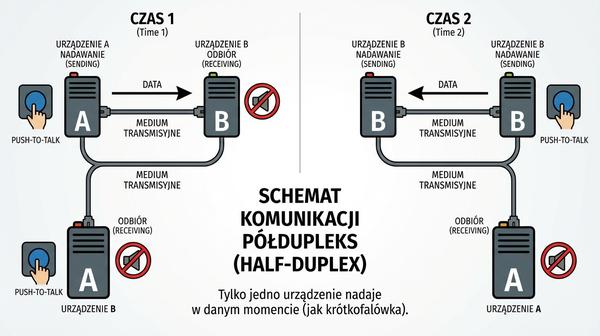

- Wszystkie sieci oparte na wspólnym medium i protokole CSMA/CD, czyli klasyczny Ethernet na kablu koncentrycznym oraz sieci z koncentratorami, działały w trybie półdupleks (half-duplex).

- Oznacza to, że w danym momencie urządzenie może albo nadawać dane, albo je odbierać, ale nigdy nie może robić obu tych rzeczy jednocześnie.

- Jest to jak rozmowa przez krótkofalówkę (walkie-talkie) – gdy jedna osoba mówi, druga musi słuchać, a potem następuje zmiana.

- Konieczność działania w tym trybie wynikała bezpośrednio z faktu, że cała sieć była jedną domeną kolizyjną i jednoczesne nadawanie z odbieraniem byłoby niemożliwe.

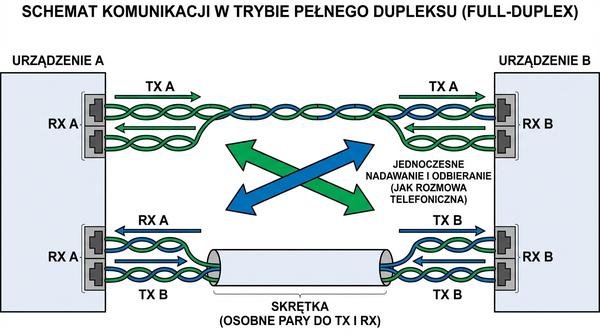

- Prawdziwa rewolucja nadeszła wraz z upowszechnieniem się przełączników (switchy), o których będziemy mówić szczegółowo w części trzeciej.

- Przełączniki, w przeciwieństwie do hubów, potrafią tworzyć dedykowane, wirtualne połączenia między portami.

- Dzięki temu, oraz dzięki zastosowaniu skrętki (która ma osobne pary żył do nadawania i odbierania), możliwe stało się działanie w trybie pełnego dupleksu (full-duplex).

- W tym trybie urządzenie może jednocześnie nadawać i odbierać dane.

- Eliminuje to całkowicie problem kolizji na danym połączeniu.

- To jak rozmowa przez telefon – obie strony mogą mówić i słuchać w tym samym czasie, co drastycznie zwiększa efektywną przepustowość.

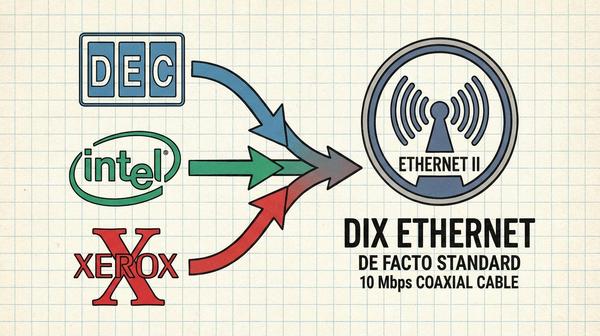

- Zanim Ethernet został oficjalnie ustandaryzowany przez organizację IEEE, na rynku dominowała jego pierwotna wersja, opracowana wspólnie przez firmy Digital Equipment Corporation, Intel oraz Xerox.

- Standard ten, znany jako DIX Ethernet lub Ethernet II, został opublikowany w 1980 roku i stał się podstawą dla przyszłych standardów.

- Różnił się on nieznacznie od oficjalnego standardu IEEE 802.3, głównie w budowie ramki (pole "Typ" w DIX vs. "Długość" w 802.3).

- Współczesne systemy operacyjne potrafią bez problemu obsługiwać oba formaty ramek, ale warto pamiętać o historycznym znaczeniu sojuszu DIX, który spopularyzował tę technologię na masową skalę.

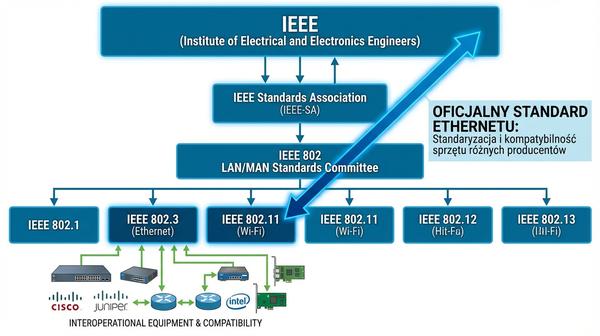

- W 1983 roku organizacja IEEE (Institute of Electrical and Electronics Engineers), odpowiedzialna za tworzenie standardów technicznych, oficjalnie ustandaryzowała Ethernet pod nazwą IEEE 802.3.

- Chociaż bazował on na standardzie DIX, wprowadzał pewne modyfikacje, m.in. w strukturze ramki.

- Standard 802.3 stał się oficjalnym dokumentem, który precyzyjnie opisywał działanie sieci, parametry okablowania, metody kodowania sygnałów i wiele innych aspektów.

- Dzięki standaryzacji, różni producenci mogli tworzyć sprzęt (karty sieciowe, koncentratory), który był ze sobą w pełni kompatybilny.

- To otworzyło drogę do masowej produkcji i ogromnego spadku cen urządzeń sieciowych.

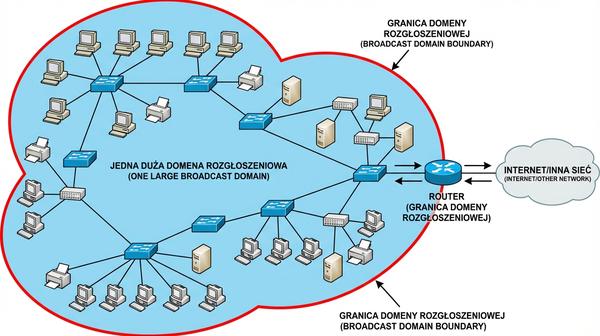

- Oprócz domeny kolizyjnej, w sieciach istnieje również pojęcie domeny rozgłoszeniowej (broadcast domain).

- Jest to obszar sieci, w którym ramka rozgłoszeniowa (broadcast frame), czyli ramka wysłana na specjalny adres MAC `FF:FF:FF:FF:FF:FF`, dotrze do wszystkich podłączonych urządzeń.

- We wczesnych sieciach Ethernet, zbudowanych z koncentratorów i repeaterów, a także w sieciach z przełącznikami (bez konfiguracji VLAN), cała sieć lokalna stanowiła jedną, wielką domenę rozgłoszeniową.

- Nadmierny ruch broadcastowy może znacząco obciążyć sieć, ponieważ każde urządzenie musi odebrać i przetworzyć taką ramkę.

- Granicę domeny rozgłoszeniowej stanowi dopiero router (urządzenie warstwy 3).

- Podsumowując, wczesne implementacje Ethernetu, mimo swojej rewolucyjności, posiadały istotne ograniczenia.

- Najważniejszym z nich był problem skalowalności wydajności.

- Ponieważ cała sieć stanowiła jedną domenę kolizyjną, dodawanie kolejnych użytkowników nieuchronnie prowadziło do wzrostu liczby kolizji i spadku przepustowości dla każdego z nich.

- Sieć stawała się "zapchana".

- Problemy z niezawodnością, zwłaszcza w topologii magistrali, oraz niska skalowalność geograficzna (ograniczenia długości kabli) sprawiały, że technologia ta nadawała się głównie do małych sieci lokalnych.

- Potrzebne były nowe rozwiązania, które pozwoliłyby przezwyciężyć te bariery.

- Ograniczenia współdzielonego Ethernetu stały się motorem napędowym dla dalszych innowacji.

- Inżynierowie zdali sobie sprawę, że kluczem do budowy większych i szybszych sieci jest segmentacja, czyli dzielenie dużej sieci na mniejsze, odizolowane od siebie domeny kolizyjne.

- Początkowo realizowano to za pomocą mostów (bridges), a następnie, w znacznie bardziej efektywny sposób, za pomocą przełączników (switchy).

- Przejście od pasywnego medium do inteligentnych urządzeń pośredniczących było kamieniem milowym, który pozwolił technologii Ethernet nie tylko przetrwać, ale i zdominować świat sieci lokalnych na kolejne dziesięciolecia.

- Choć od narodzin Ethernetu minęło już ponad 50 lat, jego podstawowe zasady wciąż są aktualne.

- Oczywiście, technologia przeszła niewyobrażalną ewolucję - od 10 Mb/s na kablu koncentrycznym do ponad 100 Gb/s na światłowodach.

- Topologia magistrali odeszła w zapomnienie na rzecz przełączanej topologii gwiazdy.

- Protokół CSMA/CD praktycznie nie jest już używany w nowoczesnych sieciach dzięki trybowi full-duplex.

- Mimo to, format ramki Ethernet, adresacja MAC i fundamentalne koncepcje pozostają z nami, stanowiąc podstawę niemal każdej sieci lokalnej na świecie i będąc kluczowym elementem dostępowym do globalnej sieci Internet.

Najważniejsze pojęcia z dzisiejszego wykładu:

- Ethernet narodził się w Xerox PARC w latach 70. jako sposób na połączenie lokalnych komputerów.

- CSMA/CD to protokół zarządzania dostępem do wspólnego medium, oparty na nasłuchiwaniu i wykrywaniu kolizji.

- Topologia fizyczna (np. magistrala, gwiazda) opisuje układ kabli, a logiczna (np. magistrala) opisuje przepływ danych.

- Wczesne sieci używały kabla koncentrycznego i topologii magistrali, co prowadziło do problemów z niezawodnością i wydajnością.

- Domena kolizyjna to obszar sieci, gdzie może dojść do zderzenia ramek. Huby i repeatery powiększają tę domenę.

- Elementy aktywne (hub, repeater) wymagają zasilania i przetwarzają sygnał, w przeciwieństwie do pasywnych (kable, złącza).

- Współczesne sieci Ethernet opierają się na skrętce, topologii gwiazdy i przełącznikach, co eliminuje problem kolizji.

- Dziękuję Państwu za uwagę. Na następnym wykładzie zajmiemy się szczegółowo urządzeniami warstwy 1 modelu ISO/OSI.